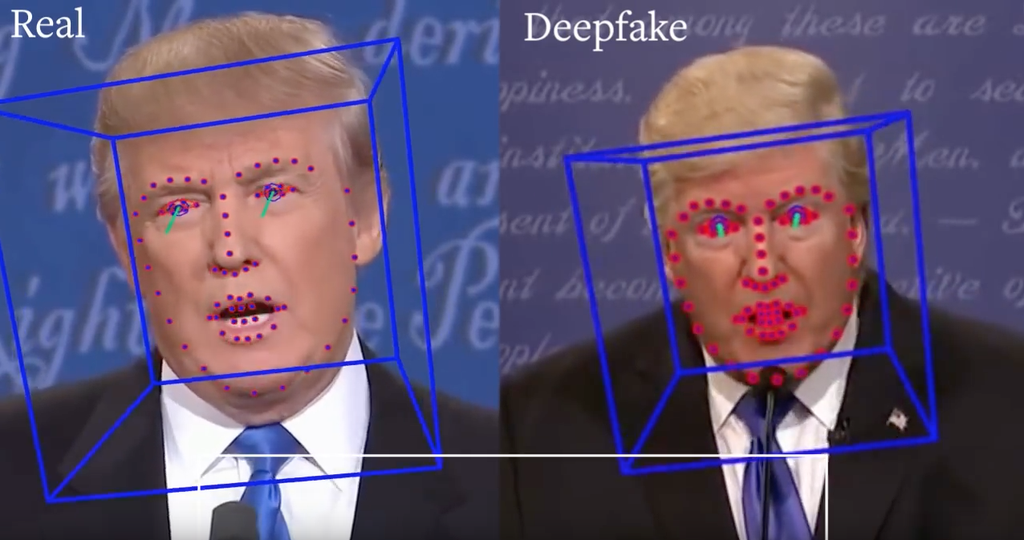

No Fórum Latinoamericano de Cibersegurança da ESET de 2025, a pesquisadora Martina López, do escritório argentino da empresa de segurança virtual da Eslováquia, destrinchou os avanços em relação a deepfakes e seu uso em campanhas de desinformação.

A especialista vê uma evolução rápida da tecnologia, que está cada vez melhor em imitar rostos, vozes e outras características importantes para a identificação de pessoas públicas, celebridades e profissionais de diversas áreas. Nos últimos meses, foram acompanhadas diversas campanhas de desinformação médica com deepfakes de profissionais da saúde, que López detalhou em suas falas.

Como são feitas campanhas de desinformação com deepfakes

Os esforços de desinformação na área da saúde, como estudado pela especialista da ESET, envolvem a criação de sites e perfis falsos de médicos, replicando a aparência e as credenciais de profissionais reais: algumas vezes, são mudadas suas formações ou detalhes como área de especialização e local de trabalho.

–

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

–

A disseminação desses conteúdos é feita em locais pouco moderados, como perfis pequenos no TikTok e redes como Kwai e Facebook, com espalhamento em grupos do Telegram, Discord e outros locais onde é mais fácil replicar conteúdo com pouca verificação.

Em alguns casos, os deepfakes são entregues, também, para públicos estudados, como outros médicos e enfermeiros, visando impactar o setor mais diretamente. São explorados, em particular, setores onde há lacunas nas informações disponíveis, como assuntos ainda não estudados de forma aprofundada ou novidades no campo.

O foco principal, no entanto, fica na manipulação de atores inocentes, como leigos, pessoas com menos educação formal e faixas etárias mais idosas.

Como combater e evitar desinformação

Em alguns países, já são realizadas campanhas para combater a desinformação por deepfakes: um exemplo é o Ato de Inteligência Artificial da União Europeia, que exige o uso de marca d’água para identificar conteúdo gerado por IA (como o gerador de vídeos Sora), bem como outras identificações e obrigações adicionais quando a tecnologia envolve dados pessoais, como biometria, e pode ser usada para manipulação emocional de usuários.

De acordo com López, ter algumas preocupações em mente poderá ajudar no combate de desinformação gerada por IA.

Para começar, é preciso entender que nossas percepções já não são suficientes para distinguir conteúdo real do fictício: a tecnologia já é capaz de reproduzir o comportamento humano com fidelidade, então teremos que depender de outros métodos e regulações para evitar a manipulação.

A especialista lembra que já há conflitos políticos, sociais, bélicos e ações de ativistas usando inteligência artificial em suas campanhas, o que demonstra a presença cada vez maior da tecnologia na vida cotidiana, o que torna conveniente redobrar o cuidado com tudo que chega até nós através das redes sociais e aplicativos de mensagem.

De início, López indica sempre buscarmos a fonte da informação apresentada, verificando se o conteúdo veio de uma página confiável ou mesmo de um artigo científico verificado. Para quem já possui mais familiaridade com a área, sinais técnicos podem ser observados, como detalhes costumeiramente inseridos por IA ou falhas recorrentes da tecnologia, como reprodução de dedos humanos, por exemplo.

Convém sempre fazer a busca reversa de imagem ou texto, inserindo o conteúdo em buscadores como o Google, que possuem ferramentas de procura do tipo. Um passo importante também é a desconfiança: use o bom senso para se perguntar quem ganharia com sua reação ao vídeo ou imagem apresentada, e o que isso te levaria a fazer.

Se a resposta for a busca por tratamentos alternativos ou compra de produtos de “limpeza corporal de remédios” e afins, o conteúdo provavelmente é voltado à desinformação.

Confira também:

- Ironia: deepfake do CEO da NVIDIA aplica golpe de criptomoedas em live falsa

- Violência, deepfake com celebridades mortas e stalker — o lado sombrio do Sora 2

- Quase 66% das empresas são impactadas por ataques de deepfake

VÍDEO: Você sabe identificar um deepfake?

Leia a matéria no Canaltech.