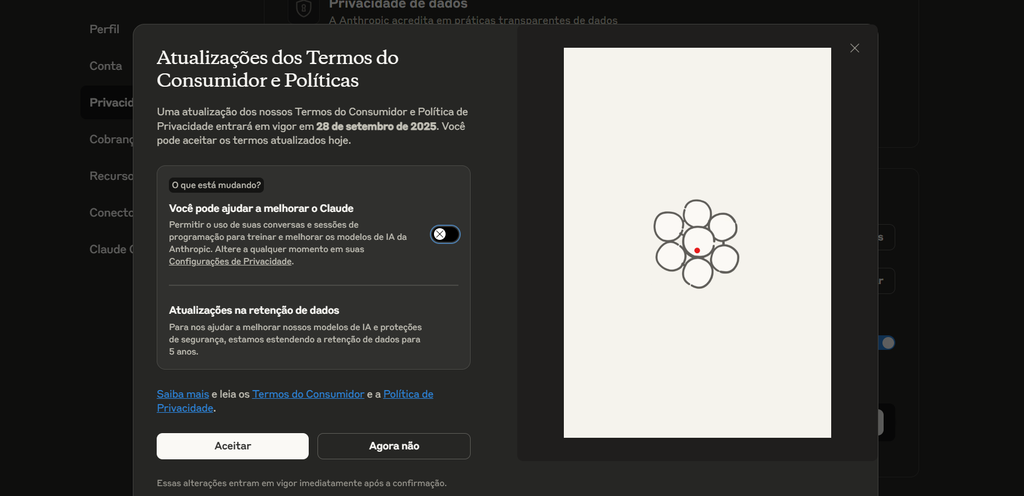

A IA Claude vai mudar a política de privacidade e poderá treinar modelos de inteligência artificial com o histórico de conversas de cada usuário. Quem abre o chatbot a partir desta quinta-feira (28) se depara com um aviso sobre as mudanças.

- Como garantir que suas conversas com o ChatGPT, Gemini e afins não vão vazar

- Privacidade nas IAs: quem tem acesso ao seu histórico de conversas?

A nova política começa a valer a partir de 28 de setembro, mas já é possível recusar o uso dos chats para treinamento. Caso a pessoa aceite os novos termos, a IA da Anthropic já poderá coletar as informações para refinar os modelos — a empresa afirma que os dados ficarão retidos nos servidores por cinco anos.

A mudança surpreende porque o Claude era uma das poucas ferramentas do mercado que não treinava LLMs com as conversas pessoais. ChatGPT, Gemini e Grok já adotavam a prática, por exemplo.

–

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

–

Em nota, a Anthropic afirma que permitir o acesso “ajuda a melhorar a segurança dos modelos” e “ajuda futuros modelos do Claude a melhorarem habilidades como programação, análise e raciocínio”. Ao aceitar as mudanças, fica a recomendação de não compartilhar dados sensíveis nas interações com a IA.

Como impedir que o Claude colete os dados treinamento

Siga estes passos:

- Abra o Claude (claude.ai/);

- Clique sobre a foto de perfil;

- Acesse “Configurações”;

- Entre em “Privacidade”;

- Desative a opção “Ajude a melhorar o Claude”.

Também é possível desativar a opção “Você pode ajudar a melhorar o Claude” exibida no pop-up ao abrir o assistente de IA. Após o dia 28 de setembro, quando os novos termos entram em vigor, o caminho pelas configurações será a única opção disponível.

Recentemente, o chatbot precisou incluir algumas travas de segurança para impedir prompts sensíveis sobre o desenvolvimento de armas nucleares.

Leia a matéria no Canaltech.