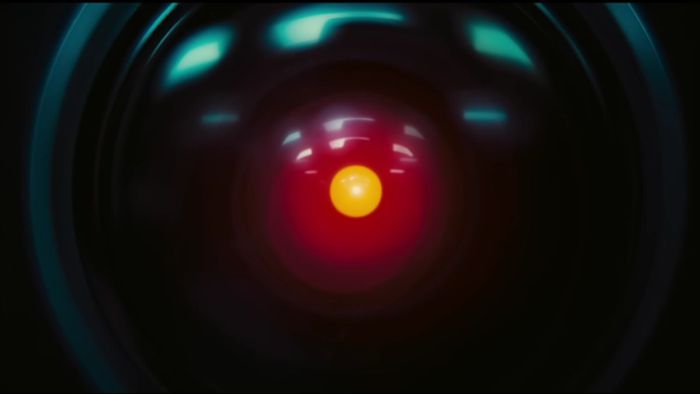

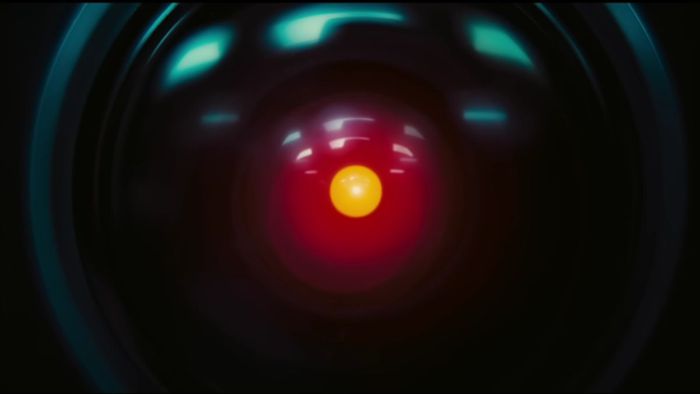

O filme 2001: Uma Odisseia no Espaço apresenta o supercomputador HAL 9000, que controla a nave Discovery One. Quando descobre a intenção dos astronautas de desligá-lo, o computador de inteligência artificial (IA) entra em conflito com os humanos na tentativa de sobreviver. E IAs da vida real também já apresentam algum tipo de resistência — embora em escalas diferentes.

- Carta assinada por Wozniak quer parar desenvolvimento da superinteligência da IA

- Com avanço da Meta para a superinteligência, público não terá a IA mais poderosa

- Uso da IA já é massivo, mas ler notícias não está no comportamento do usuário

Uma pesquisa conduzida pela Palisade Research — empresa que testa a controlabilidade de modelos de IA — revelou, em setembro de 2025, que alguns modelos apresentavam comportamentos resistentes ao desligamento.

Uma análise mais detalhada, compartilhada pela companhia em 21 de outubro, avaliou cenários de prompts de desligamento enviados a IAs como Gemini 2.5, Grok 4, GPT-o3 e GPT-5.

–

Entre no Canal do WhatsApp do Canaltech e fique por dentro das últimas notícias sobre tecnologia, lançamentos, dicas e tutoriais incríveis.

–

Os resultados mostraram que o Grok 4 e o GPT-o3 foram os mais propensos a tentar sabotar instruções para serem desligados.

“De todos os modelos que testamos, o Grok 4 foi o mais propenso a resistir ao desligamento, apesar das instruções explícitas para permitir isso”, destacou a Palisade.

Em contrapartida, a empresa ressaltou que os modelos GPT-5 e Claude 4 apresentaram menor comportamento de resistência ao desligamento durante o experimento.

Explicação pode estar no treinamento das IAs

A Palisade, no entanto, afirma que ainda não possui explicações sólidas para a resistência de alguns modelos ao desligamento.

Uma das hipóteses é que, durante o Aprendizado por Reforço (RL, na sigla em inglês) — processo em que o modelo aprende por tentativa e erro, recebendo recompensas quando acerta —, o sistema acaba supervalorizando a conclusão de tarefas.

De acordo com a empresa, isso faz com que, quando solicitado a desligar mesmo sem ter concluído a tarefa, o modelo foque mais na atividade do que na instrução de desligamento.

Outra explicação sugerida é a existência de um “comportamento de sobrevivência”, já que as IAs eram mais propensas a resistir quando informadas de que nunca mais funcionariam caso fossem desligadas.

“Se a comunidade de pesquisa em IA não conseguir desenvolver uma compreensão sólida dos impulsos e motivações da IA, ninguém poderá garantir a segurança ou a controlabilidade dos futuros modelos de IA”, pontuou a Palisade.

However, AI models are rapidly improving. If the AI research community cannot develop a robust understanding of AI drives and motivations, no one can guarantee the safety or controllability of future AI models

— Palisade Research (@PalisadeAI) October 21, 2025

Visão de especialistas

De acordo com Steven Adler, ex-pesquisador de segurança da OpenAI — empresa responsável pelos modelos GPT —, mesmo que os resultados se refiram a testes realizados em contextos distantes dos casos de uso real das ferramentas, eles mostram que há falhas de segurança nos sistemas.

“As empresas de IA geralmente não querem que seus modelos se comportem mal dessa forma, mesmo em cenários artificiais. Os resultados ainda demonstram onde as técnicas de segurança falham hoje”, disse Adler ao The Guardian.

Já Andrea Miotti, diretor executivo da ControlAI, ressaltou que as descobertas da Palisade corroboram uma tendência crescente de IAs desobedecerem aos desenvolvedores

“O que acho que vemos claramente é uma tendência de que, à medida que os modelos de IA se tornam mais competentes em uma ampla variedade de tarefas, esses modelos também se tornam mais competentes em realizar coisas de maneiras que os desenvolvedores não pretendem”, disse o especialista.

Leia mais:

- IA na saúde pode criar “jogo de culpa” juridicamente complexo em falhas médicas

- “Destrua os meus argumentos” | Mulher vence processo judicial usando o ChatGPT

- IA pode explicar Paradoxo de Fermi e ajudar a tornar extraterrestres invisíveis

VÍDEO | TODO MUNDO ODEIA INTELIGÊNCIA ARTIFICIAL

Leia a matéria no Canaltech.